イメージング/センシング事業の清水氏、AIロボディクス事業の川西氏に訊く

<CES>ソニーの自動車「VISION-S」はどこに向かう? コア技術を主導する幹部2名が会見

米国ラスベガスにて開催中の、世界中から様々な分野の企業が集う「CES 2020」。自動車の新コンセプト「VISION-S」プロトタイプ車両を発表したソニーは、日本人記者団の質問に幹部が答えるラウンドテーブルを開催。 イメージング&センシング・ソリューション事業担当のソニー(株)常務 清水照士氏と、AIロボティクスビジネス担当の執行役員 川西 泉 氏という、VISION-Sのコア部分に関わる両氏に話を訊いた。

清水氏はソニー(株)の常務であるとともに、ソニーセミコンダクタソリューションズの代表取締役社長でもある人物。例えばスマートフォンのカメラ用のCMOSセンサーを各社に提供するなどしているイメージング&センシング・ソリューション事業を統括している。

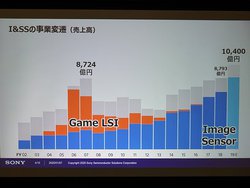

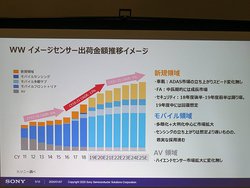

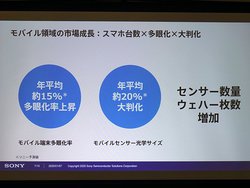

清水氏はまず、イメージングおよびセンシングソリューションの市場動向に言及。スマートフォンにおけるカメラの多眼化とイメージセンサーの大判化の流れが非常に早くなっていると紹介。2018年度はソニーのイメージング・センシング事業のなかでのセンシングの売上構成比はわずか数%だったが、こうした世の中の流れもあって、2025年度には30パーセントを占めるところまで事業を伸ばしたいという考えを示した。

一方の川西氏は、開発責任者としてaiboを世に送り出すなどしてきた人物で、今回の「VISION-S」プロトタイプ車両開発も主導。かつてはソニー・コンピューターエンタテインメントでPSPを開発したり、ソニーモバイルコミュニケーションズの商品開発全般を見る取締役を務めた経歴も持っている。

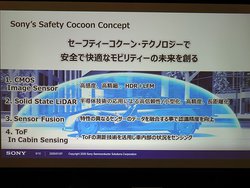

清水氏の担当するイメージングとセンシング、川西氏の担当するAIロボティクスは、ともに「VISION-S」のコアを成す重要な技術だ。川西氏は「車の進化に貢献したいということでVISION-Sを発表した」と語る。

そして「(スマホに代表される)モバイルの進化によるパラダイムシフトのインパクトは非常に大きかった。では、その次のインパクトは何かと考えたときに、それが自動車だと判断した」とし、「センサーの技術やAVの技術といったソニーのクリエイティビティが、モビリティ分野でどうユーザー体験を提供できるかを考えた」と述べる。

また、「いままで、車は買ったらそのまま使い続けるのが普通だったが、EVによってそれが変わってきている」とコメント。「ITの技術をベースに考えてモビリティをもう一回つくったらどうなるか。将来的な自動運転まで含めた上で車の進化というサービスをソニーが提供できるかなと考えた」と、プロトタイプ車両第一弾発表に至った背景を説明した。

以下、記者陣との一問一答をお届けする。

<VISION-Sについて>

――ソニーが車メーカーになるイメージは持っているのか。

今の段階としては「ない」というのが回答だ。車の中でどう楽しんでもらえるかがポイントだと考えている。ソニーはもともとパーソナルなものをつくってきた。(徒歩や電車内でウォークマンやイヤホンで音楽を聴くといったように)移動中にソニーの商品を使ってもらっているので、だったら移動そのものをエンタメにしようと考えた。

――テスラとの差別化ポイントは? また、ソニーが考える、ソフトウェアベースの車、ITベースの車というのは何なのか。

車とはパーソナルな空間。それを考えるとキャビンのなかでの快適性や乗り心地といった部分に、ソニーのさまざまな技術が使えると考えた。ただ、大前提として、安心して乗れる車でないとその楽しさもない。安心安全を確保した上でリラックスした空間をつくっていくというのがコンセプトだ。

――人の命に関わるという意味で、車そのものをつくるのには部品だけよりかなり責任も大きいが、何があったのか。

まず、2年前にaiboの発売に際して工場のインフラを見たりしているなかで、(今回のようなことも)ある程度やれるかなと思ったので検討を始めた。実際に開発に具体的に着手し始めたのは1年前くらいだ。

――自動運転についてはどう捉えているか。

ADAS(先進運転支援システム/自動運転のレベルを0〜5の5段階で定義している)で言うと、今回のプロトタイプ車両はレベル2+となっている。最初のステップとしての実験車両であり、現状は車としての安全基準をクリアしていないのでナンバーを取得できない。安全基準も世界各国で様々条件が異なっているが、日米欧ではナンバーをとろうと思ってる。今年の目標は公道走行だ。アウトバーンで時速100km出してどうなるかなどのデータをとってフィードバックできれば。また、別の角度から見ると、つくってみてどこにセンシングが使えるかがわかる部分もあるので、今回はつくったことに意味があるとも言える部分もある。

――VISION-Sのデザインのポイントは?

デザインと車の性能は密接に結びついている。ベースとなるシャーシはEVのプラットフォームとして別につくっているので、ボディは今回のような形でなくても構わない。SUVのようにすることも可能だ。今回は光をモチーフにしたいと考えたデザインで、インテリアにもアンビエントライトが光ったりする。床にバッテリーを入れているので、実は今回のようなスポーティなデザインは、体積的に厳しい。コンパクトかつ乗り心地を損なわないものという、技術的には高い要求のものになっている。

――搭載したセンサーの数が33個というのは最初の計画どおりの数字なのか。

いや、載せられるならばもっと載せたいくらいだ(笑)。例えばもっと全周囲を見るなど、やりたいことはまだあるのだが、デザインを損なわないようにするというのが難しい。

――(自動車を)つくって学んだことはどんなことがあるか。

学んだことは非常に多い。ひとつ言えるのは、ものづくりの観点から、いままで我々がつくってきたものとかなり近いのかなと感じた。また、今回、マグナ・インターナショナルなどと一緒に開発に取り組んだわけだが、お互いに業界用語が違っていて会話できないことも最初はあった。しかしつくっていくうちに、お互いのマインドはかなり近いなとも感じた。

――センサーはミドルウェアも重要になると思う。例えば今後、車体メーカーから「こんなセンサーが欲しい」というオーダーもあったりした場合に、ソニーなりの価値が出てくるのではないかと思うのだが、どう考えるか。

ソニーの技術をどこに集約したら一番うまくインテグレーションできるかだ。安心安全だったりメインキャビンのモニタリングなどは実際に使ってみてフィードバックできる部分もある。

――VISION-Sをつくることでポジションを変えていこうという考えなのか。例えばOEMになっていくだとかサービサーになっていくなどのアプローチはあるのか。また、センサーにはLIDAR(レーザー光を用いたセンシング技術)への進出も表明しているが、いまのセンサーとのコンフュージョンなども考えていくのか。

メカニカルなものからソリッドステートに変えることのメリットは大きいと世界中の会社がLIDARを検討している(編集部注:LIDARはソニーの技術ではない。今回のCESでのオートモーティブ関連はLIDARに関する出展をする企業も目立った)。我々の元々の技術をLIDARのなかの受光素子に反映したというのが今回の背景だ。センサーはセンサー、カメラはカメラ、LIDARはLIDARでということでいくことになるだろう。

――ソフトウェアとセンサーなどをバンドルしたパッケージとして事業化するなどのイメージはあるのか。

現時点で具体的にどうこうというのはないが、可能性はあると思う。

――今回、360 Reality AudioをVISION-Sに入れたが、他社の車に360 Reality Audioを提供するといったことはあり得るのか。

具体的なものはないが、そういう可能性もあるとは思う。

――モーターなどは他社から提供を受けているということか。

基本的なパーツは、提供を受けた汎用的な部品を使っている。

――川西さんはプレイステーションにも関わっていたが、今回、VISION-Sのプロジェクトにゲーム関係のスタッフは加わっているのか。

いまは入ってない。ただ、プレイステーションと通じるものがあるとは思っていて、VISION-Sもプレイステーションもたんなるハードウェアだとは思っていない。プラットフォームだと考えている。ちなみに、VISION-S開発陣は人数が非常に少ない(笑)。

<スマートフォン等のイメージングセンサーについて>

――センサーについては、海外の、特にスマホ周辺では1億画素のカメラなど高画素化の流れがある一方で、ソニーとしては多眼化と大判化に進んできた。この市場のトレンドが今後どういうふうになっていくと見ているのか。

我々のコンセプトは、例えば暗所などさまざまなシーンでも高画質を実現することにこだわっている。高画素を追求しすぎるとそういう暗所撮影時での画質低下などのデメリットがある。デジカメが出始めたころと似た状況とも言えるが、スマホのカメラにも適切な画素数というものがある。スマホ向けのカメラは多眼化を使いながら、今後は5Gで動画撮影のことも考えないといけない。これらの状況から、スマホのカメラは多眼化と大判化だろうというのが我々の考え方だ。

――多眼化、大判化はどのくらいまで行くと見ているか。

お客様(端末メーカー)と話しているなかでは、2023年か2024年くらいまでは続いていくだろうと見ている。現状で最も多眼カメラなスマホは七眼で、平均は2個と3個のあいだくらいだ。一方で、多眼化していくだけでなく、今後、例えばカメラ2個ぶんの機能を1個にまとめるなどの技術革新もあるだろう。

――センサーの最新技術はどこに向かっているのか。

我々の開発には2つの方向がある。100メガ画素までいってしまうと、レンズの技術がセンサーに追いつかない。今の64メガくらいまでならレンズとちょうどいい状況だ。また、感度も保ったままで解像度も上げていくとなると、ピクセルサイズもある程度大きくしなくてはいけない。その先には有機光電変換膜などのような、材料の革新も含んでやっていくことになるだろう。ただ、そうした大きな変革の前にはまだやることがあるのかなと思っている。

清水氏はソニー(株)の常務であるとともに、ソニーセミコンダクタソリューションズの代表取締役社長でもある人物。例えばスマートフォンのカメラ用のCMOSセンサーを各社に提供するなどしているイメージング&センシング・ソリューション事業を統括している。

清水氏はまず、イメージングおよびセンシングソリューションの市場動向に言及。スマートフォンにおけるカメラの多眼化とイメージセンサーの大判化の流れが非常に早くなっていると紹介。2018年度はソニーのイメージング・センシング事業のなかでのセンシングの売上構成比はわずか数%だったが、こうした世の中の流れもあって、2025年度には30パーセントを占めるところまで事業を伸ばしたいという考えを示した。

一方の川西氏は、開発責任者としてaiboを世に送り出すなどしてきた人物で、今回の「VISION-S」プロトタイプ車両開発も主導。かつてはソニー・コンピューターエンタテインメントでPSPを開発したり、ソニーモバイルコミュニケーションズの商品開発全般を見る取締役を務めた経歴も持っている。

清水氏の担当するイメージングとセンシング、川西氏の担当するAIロボティクスは、ともに「VISION-S」のコアを成す重要な技術だ。川西氏は「車の進化に貢献したいということでVISION-Sを発表した」と語る。

そして「(スマホに代表される)モバイルの進化によるパラダイムシフトのインパクトは非常に大きかった。では、その次のインパクトは何かと考えたときに、それが自動車だと判断した」とし、「センサーの技術やAVの技術といったソニーのクリエイティビティが、モビリティ分野でどうユーザー体験を提供できるかを考えた」と述べる。

また、「いままで、車は買ったらそのまま使い続けるのが普通だったが、EVによってそれが変わってきている」とコメント。「ITの技術をベースに考えてモビリティをもう一回つくったらどうなるか。将来的な自動運転まで含めた上で車の進化というサービスをソニーが提供できるかなと考えた」と、プロトタイプ車両第一弾発表に至った背景を説明した。

以下、記者陣との一問一答をお届けする。

<VISION-Sについて>

――ソニーが車メーカーになるイメージは持っているのか。

今の段階としては「ない」というのが回答だ。車の中でどう楽しんでもらえるかがポイントだと考えている。ソニーはもともとパーソナルなものをつくってきた。(徒歩や電車内でウォークマンやイヤホンで音楽を聴くといったように)移動中にソニーの商品を使ってもらっているので、だったら移動そのものをエンタメにしようと考えた。

――テスラとの差別化ポイントは? また、ソニーが考える、ソフトウェアベースの車、ITベースの車というのは何なのか。

車とはパーソナルな空間。それを考えるとキャビンのなかでの快適性や乗り心地といった部分に、ソニーのさまざまな技術が使えると考えた。ただ、大前提として、安心して乗れる車でないとその楽しさもない。安心安全を確保した上でリラックスした空間をつくっていくというのがコンセプトだ。

――人の命に関わるという意味で、車そのものをつくるのには部品だけよりかなり責任も大きいが、何があったのか。

まず、2年前にaiboの発売に際して工場のインフラを見たりしているなかで、(今回のようなことも)ある程度やれるかなと思ったので検討を始めた。実際に開発に具体的に着手し始めたのは1年前くらいだ。

――自動運転についてはどう捉えているか。

ADAS(先進運転支援システム/自動運転のレベルを0〜5の5段階で定義している)で言うと、今回のプロトタイプ車両はレベル2+となっている。最初のステップとしての実験車両であり、現状は車としての安全基準をクリアしていないのでナンバーを取得できない。安全基準も世界各国で様々条件が異なっているが、日米欧ではナンバーをとろうと思ってる。今年の目標は公道走行だ。アウトバーンで時速100km出してどうなるかなどのデータをとってフィードバックできれば。また、別の角度から見ると、つくってみてどこにセンシングが使えるかがわかる部分もあるので、今回はつくったことに意味があるとも言える部分もある。

――VISION-Sのデザインのポイントは?

デザインと車の性能は密接に結びついている。ベースとなるシャーシはEVのプラットフォームとして別につくっているので、ボディは今回のような形でなくても構わない。SUVのようにすることも可能だ。今回は光をモチーフにしたいと考えたデザインで、インテリアにもアンビエントライトが光ったりする。床にバッテリーを入れているので、実は今回のようなスポーティなデザインは、体積的に厳しい。コンパクトかつ乗り心地を損なわないものという、技術的には高い要求のものになっている。

――搭載したセンサーの数が33個というのは最初の計画どおりの数字なのか。

いや、載せられるならばもっと載せたいくらいだ(笑)。例えばもっと全周囲を見るなど、やりたいことはまだあるのだが、デザインを損なわないようにするというのが難しい。

――(自動車を)つくって学んだことはどんなことがあるか。

学んだことは非常に多い。ひとつ言えるのは、ものづくりの観点から、いままで我々がつくってきたものとかなり近いのかなと感じた。また、今回、マグナ・インターナショナルなどと一緒に開発に取り組んだわけだが、お互いに業界用語が違っていて会話できないことも最初はあった。しかしつくっていくうちに、お互いのマインドはかなり近いなとも感じた。

――センサーはミドルウェアも重要になると思う。例えば今後、車体メーカーから「こんなセンサーが欲しい」というオーダーもあったりした場合に、ソニーなりの価値が出てくるのではないかと思うのだが、どう考えるか。

ソニーの技術をどこに集約したら一番うまくインテグレーションできるかだ。安心安全だったりメインキャビンのモニタリングなどは実際に使ってみてフィードバックできる部分もある。

――VISION-Sをつくることでポジションを変えていこうという考えなのか。例えばOEMになっていくだとかサービサーになっていくなどのアプローチはあるのか。また、センサーにはLIDAR(レーザー光を用いたセンシング技術)への進出も表明しているが、いまのセンサーとのコンフュージョンなども考えていくのか。

メカニカルなものからソリッドステートに変えることのメリットは大きいと世界中の会社がLIDARを検討している(編集部注:LIDARはソニーの技術ではない。今回のCESでのオートモーティブ関連はLIDARに関する出展をする企業も目立った)。我々の元々の技術をLIDARのなかの受光素子に反映したというのが今回の背景だ。センサーはセンサー、カメラはカメラ、LIDARはLIDARでということでいくことになるだろう。

――ソフトウェアとセンサーなどをバンドルしたパッケージとして事業化するなどのイメージはあるのか。

現時点で具体的にどうこうというのはないが、可能性はあると思う。

――今回、360 Reality AudioをVISION-Sに入れたが、他社の車に360 Reality Audioを提供するといったことはあり得るのか。

具体的なものはないが、そういう可能性もあるとは思う。

――モーターなどは他社から提供を受けているということか。

基本的なパーツは、提供を受けた汎用的な部品を使っている。

――川西さんはプレイステーションにも関わっていたが、今回、VISION-Sのプロジェクトにゲーム関係のスタッフは加わっているのか。

いまは入ってない。ただ、プレイステーションと通じるものがあるとは思っていて、VISION-Sもプレイステーションもたんなるハードウェアだとは思っていない。プラットフォームだと考えている。ちなみに、VISION-S開発陣は人数が非常に少ない(笑)。

<スマートフォン等のイメージングセンサーについて>

――センサーについては、海外の、特にスマホ周辺では1億画素のカメラなど高画素化の流れがある一方で、ソニーとしては多眼化と大判化に進んできた。この市場のトレンドが今後どういうふうになっていくと見ているのか。

我々のコンセプトは、例えば暗所などさまざまなシーンでも高画質を実現することにこだわっている。高画素を追求しすぎるとそういう暗所撮影時での画質低下などのデメリットがある。デジカメが出始めたころと似た状況とも言えるが、スマホのカメラにも適切な画素数というものがある。スマホ向けのカメラは多眼化を使いながら、今後は5Gで動画撮影のことも考えないといけない。これらの状況から、スマホのカメラは多眼化と大判化だろうというのが我々の考え方だ。

――多眼化、大判化はどのくらいまで行くと見ているか。

お客様(端末メーカー)と話しているなかでは、2023年か2024年くらいまでは続いていくだろうと見ている。現状で最も多眼カメラなスマホは七眼で、平均は2個と3個のあいだくらいだ。一方で、多眼化していくだけでなく、今後、例えばカメラ2個ぶんの機能を1個にまとめるなどの技術革新もあるだろう。

――センサーの最新技術はどこに向かっているのか。

我々の開発には2つの方向がある。100メガ画素までいってしまうと、レンズの技術がセンサーに追いつかない。今の64メガくらいまでならレンズとちょうどいい状況だ。また、感度も保ったままで解像度も上げていくとなると、ピクセルサイズもある程度大きくしなくてはいけない。その先には有機光電変換膜などのような、材料の革新も含んでやっていくことになるだろう。ただ、そうした大きな変革の前にはまだやることがあるのかなと思っている。